在机器学习中,基于基本的梯度下降法发展了三种梯度下降方法,分别为随机梯度下降法,批量梯度下降法以及小批量梯度下降法。 (1)批量梯度下降法(Batch Gradient Descent,BGD) BGD 得到的是一个全局最优解,但是...

”随机梯度下降 机器学习“ 的搜索结果

Adam 设计用于处理随机梯度下降问题; 即当仅使用小批量数据来估计每次迭代的梯度时,或使用随机 dropout 正则化时 [2]。 有关示例,请参阅 GIT 存储库: https://github.com/DylanMuir/fmin_adam 用法: [x, fval...

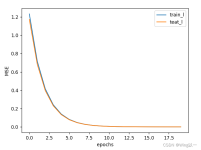

随机梯度下降 定义:每次进行参数更新的时候仅仅使用数据集中的一个数据,也即batch_size = 1 算法 特点 更新参数的时候每次只用计算一个数据,因此能够更快地更新参数 但是因为每次只使用了一个数据,所以更新参数...

主要为大家详细介绍了Spark MLlib随机梯度下降法概述与实例,具有一定的参考价值,感兴趣的小伙伴们可以参考一下

用决策树分类:从根节点开始,对实例的某一特征进行测试,根据测试结果将实例分配到其子节点,此时每个子节点对应着该特征的一个取值,如此递归的对实例进行测试并分配,直到到达叶节点,最后将实例分到叶节点的类中...

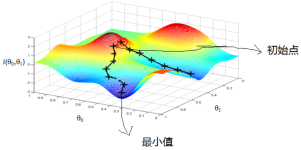

● SGD算法中对于每个样本都需要更新参数值,...:初始值不同,最终获得的最小值也有可能不同,因为梯度下降法求解的是局部最优解,所以一般况下,选择多次不同初始值运行算法,并最终返回损失函数最小情况下的结果值;

1.梯度下降 1)什么是梯度下降? 因为梯度下降是一种思想,没有严格的定义,所以用一个比喻来解释什么是梯度下降。 简单来说,梯度下降就是从山顶找一条最短的路走到山脚最低的地方。但是因为选择方向的...

不是一个机器学习的算法 是一个基于搜索的最优化方法 作用:最小化一个损失函数 梯度上升法:最大化一个效用函数 (不管在最低点哪一侧都会是,都会是下降的) 关于参数eta 并不是所有函数都有唯一的极值点 ...

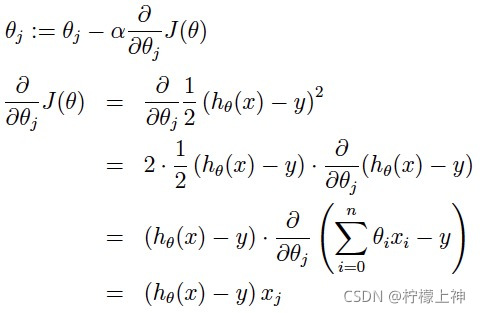

梯度下降算法是求解无约束多元函数极值最常用的数值方法, 很多机器学习常用算法和神经网络都是以它作为算法框架进行优化参数。 所以这个算法非常重要。梯度下降也是一种优化算法, 通过迭代的方式寻找使模型目标...

梯度下降

最近面试有要求手撕SGD,这里顺便就把梯度下降、随机梯度下降、批次梯度下降给写出来了。1.求梯度时注意label[i]和pred[i]不要搞反,否则会导致模型发散。2.如果跑了几千个epoch,还是没有收敛,可能是学习率太小了...

您需要使用课程中介绍的随机梯度下降法来实现一个版本的软边距支持向量机。您将在给定的数据集(从课程网站下载)上运行代码,然后对测试数据集进行预测。衡量你得分的标准是你在测试数据集上的准确性。(提示:由于...

随机平均梯度算法克服了这个问题,在内存中为每一个样本都维护一个旧的梯度,随机选择第i个样本来更新此样本的梯度,其他样本的梯度保持不变,然后求得所有梯度的平均值,进而更新了参数。在SG方法中,虽然避开了...

换而言之,只要我们找到的参数能让J(θ)的值最小,即表示我们找到了最能表示特征与结果之间关系的参数,而找到这个函数最小值对应的θ的方法包括梯度下降法。梯度可以理解为一个向量,它指向了函数增长最快的方向,不懂的...

随机梯度下降(Stochastic Gradient Descent, SGD)及其变种很可能是一般机器学习中应用最多的的优化算法,特别是在深度学习中。如《优化技术:基础知识》中所讨论的,按照数据生成分布抽取mmm个小批量(独立同分布...

机器学习算法基础-批量随机梯度下降法回归法

其中,随机梯度下降(Stochastic Gradient Descent, SGD)算法是机器学习和深度学习中最基础和最重要的优化算法之一。SGD算法简单高效,在训练大规模神经网络时表现出色,被广泛应用于各种机器学习任务中。近年来,元学习...

随机梯度下降(Stochastic Gradient Descent, SGD)是机器学习领域中一种广泛使用的优化算法,它通过迭代地更新参数来最小化目标函数。在强化学习中,SGD也扮演着重要的角色,被用于训练各种强化学习模型,如策略梯度算法...

用MATLA实现机器学习中的批处理梯度下降法和随机梯度下降法

这个术语通常指的是(或最大化)的函数。在机器学习和优化中,目标函数可以包括损失函数以及正则化项...在机器学习和深度学习中,,而梯度是一种用于指导参数更新的重要工具。(Stochastic Gradient Descent)的缩写。

1.背景介绍 监督学习是机器学习中最基本的学习方法...梯度下降和随机梯度下降是两种常用的优化算法,它们在监督学习中发挥着重要作用。 在本文中,我们将从以下几个方面进行讨论: 背景介绍 核心概念与联系 核心...

本文主要介绍随机梯度下降法

针对现有分布式计算环境下随机梯度下降算法存在效率性与私密性矛盾的问题,提出一种 MapReduce框架下满足差分隐私的随机梯度下降算法。该算法基于MapReduce框架,将数据随机分配到各个Map节点并启动Map分任务独立...

全梯度下降算法(FGD)、随机梯度下降算法(SGD)、随机平均梯度下降算法(SAGD)、小批量梯度下降算法(Mini-batch gradient descent,MGD)梯度下降优化算法,动量法、Adagrad、Adadelta、RMSProp、Adam

推荐文章

- GPT-ArcGIS数据处理、空间分析、可视化及多案例综合应用

- 在Debian 10上安装MySQL_debian mysql安装-程序员宅基地

- edge 此项内容已下载并添加到 Chrome 中。_一个小扩展,解决Chrome长期以来的大痛点...-程序员宅基地

- vue js 点击按钮为当前获得焦点的输入框输入值_vue获得当前获得焦点的元素-程序员宅基地

- Android 资源文件中@、@android:type、@*、?、@+含义和区别_@android @*android-程序员宅基地

- python中的正则表达式是干嘛的_Python中正则表达式介绍-程序员宅基地

- GeoGeo多线程_geo 多线程-程序员宅基地

- phpstudy的Apache无法启动_phpstudy apache无-程序员宅基地

- 数据泵导出出现ORA-31617错误-程序员宅基地

- java基础巩固-宇宙第一AiYWM:为了维持生计,两年多实验室项目经验之分层总结和其他后端开发好的习惯~整起_java两年经验项目-程序员宅基地